ローカルLLMを使ってみよう!

こんにちは。TENTOスタッフのSです。

プログラミングをしていて、「このエラーがわからない」「コードの書き方をもっと効率化したい」と思ったことはありませんか?最近は、chatGPTやGeminiなどのAIに聞くのが当たり前になってきていますが、実は、自分のパソコン(ローカル)の中に、ネットを使わずに動かせる、自分専用のAIを構築することができるんです。このローカルに構築することのできるAIのことをローカルLLMと呼びます。

今日は実際にローカルLLMを動かすための環境を構築して、ローカルLLMを使ってみようと思います。

そもそも「ローカルLLM」とは?

このブログのイントロダクションでも少しだけ触れましたが、ローカルLLMについて、もう少しだけ詳しく説明したいと思います。

まず、「LLM(Large Language Model / 大規模言語モデル)」は、人間のように言葉を理解してコードを書いてくれるAIのことです。みんながよく耳にしたり使っているであろう、chatGPTやGeminiなどは「クラウドLLM」と呼ばれ、インターネットの先にある巨大なサーバーにデータを送って回答をもらいます。これに対して「ローカルLLM」は、自分のパソコンのCPUやGPUのパワーを使って、その場でAIを動かします。

ローカルLLMを使うことのメリット

①オフラインでもAIを使える

ローカルLLMは、パソコンのCPUやGPUのパワーを使って動かすため、Wi-Fiなどの通信環境を必要としません。そのため、外出先や移動中でもAIを使うことができるんです。

②コスト管理がしやすい

ローカルLLMは無料で公開されているものも多く、また購入するとしてもサブスクではなく一回買い切りです。そのため、有料プランの制限を気にせず、何度でもコードの相談ができます。

③圧倒的なプライバシー

入力したデータが外に出ないので、未発表の自作ゲームのコードを読み込ませても安心です。

環境構築をしよう

LM Studioのインストールと設定

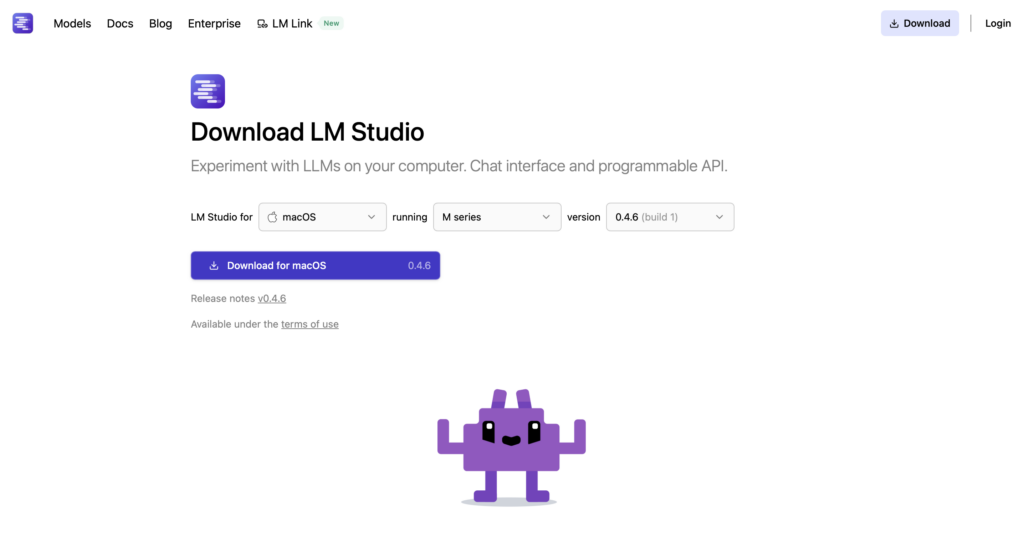

まずは、ローカルで動かすためのAIを自分のパソコンにインストールします。今回は、「LM Studio」というプラットフォームを使用します。画面UIはバージョンによって異なるので、スクショとは違う可能性があります。今回はmacを使用しています。

1.LM Studioをインストール: 公式サイトからダウンロードして起動します。ダウンロードするときは、自分のパソコンに合う種類をダウンロードしてください。

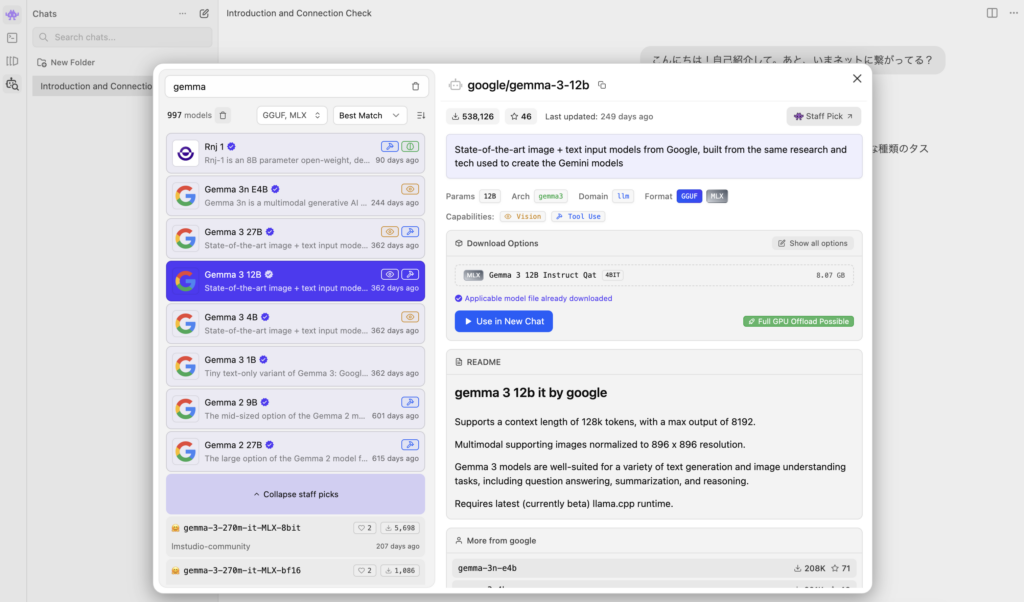

2.モデルを選ぶ:ダウンロードが終わり、LM Studioを開いたらモデルを選びます。左のメニューボタンのModel Searchを選択肢、使用するLLMモデルを取得します。今回は、google/gemma-3-12bを使用します。

(「4b」や「12b」という数字はAIの賢さ(パラメーター数)です。自分のPCのメモリ容量に合わせて選んでみてください。)

LM Studioの設定はこれで終わりです。

実際に使ってみる

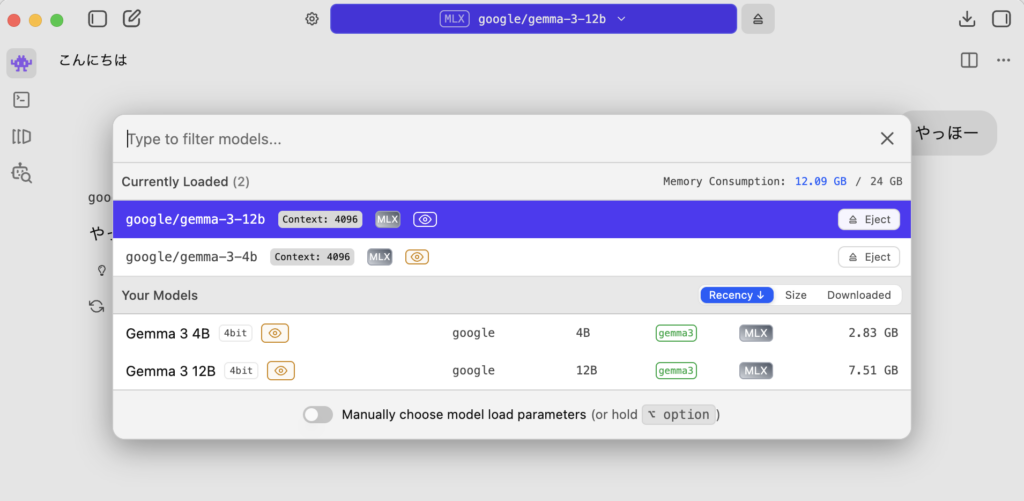

LM Studioの設定の環境構築が終わったら、実際に使ってみたいと思います。

左のChatアイコンをクリックし、一番上の「Select a model to load」から、今ダウンロードしたモデルを選びます。

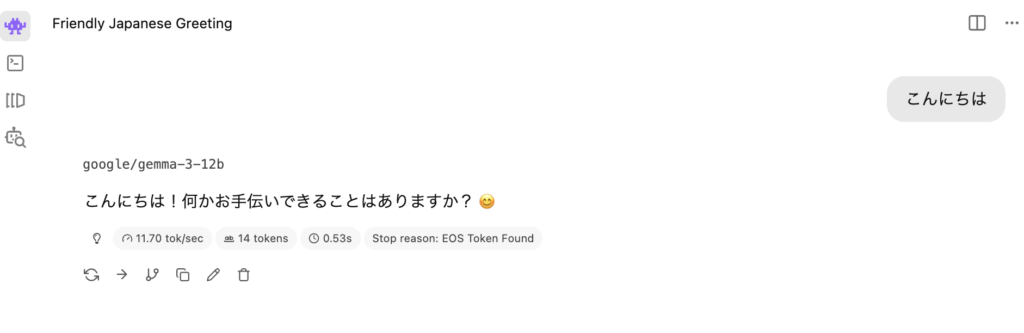

ここでWi-Fiを切ってみましょう!

「こんにちは」と送ってみてください。ネットがなくてもAIが返事をしてくれたら成功です!

発展編:VS Codeとつなげば、最強の「開発相棒」に!

ローカルLLMの本当の凄さは、プログラミングをするツール(VS Codeなど)と合体させたときに発揮されます。

「Continue」という拡張機能(プラグイン)を使うと、VS Codeの中でAIと直接やり取りできるようになります。

気になる人は、気になる人は、ぜひ以下のヒントを頼りしたり、「LM Studio Continue 連携」で調べたりして、自分だけの開発環境を作ってみてください!

構築のヒント

・LM Studioの「Local Server」を起動して、AIを外部から使える状態にする必要がある。

・VS Codeに「Continue」という拡張機能をインストールする必要がある。

・Continueの設定(config.json)で、LM Studioに接続するように書き換える。

TENTOのおすすめポイント

- 日本初のプログラミング教室として2011年から14年の歴史を持つTENTOは、豊富な経験とノウハウで生徒一人ひとりに寄り添った指導を行っています。正解のコードを示すだけでなくこの記事のような解説ができるので意味の理解を助けます。

- 独自のオンライン授業システム「noiz」により、生徒と講師、さらに生徒同士のコミュニケーションをスムーズにし、学習環境をさらに向上させています。最初は一緒にコードを書いていてもすぐに自分の考えを反映しながらコードを作りはじめます。

- 体験授業の充実。まずは無料体験講座で教室の雰囲気を体験でき、リラックスして始められます。

- 機材サポート。PCの貸出やオンラインワークショップの開催など、学びやすい環境が整っています。

体験授業ご希望の方はお気軽にお申し込みください。

友達募集中・LINE公式アカウントはじめました!